Las amenazas informáticas evolucionan con rapidez. Cada vez que un virus es descubierto o una vulnerabilidad es corregida, no hay que esperar demasiado para que otra vea la luz. Por eso, los propios sistemas operativos (SO) ofrecen sus protocolos de seguridad. En el caso de los computadores que usan Windows, Microsoft brinda su paquete de seguridad, Windows Defender, que viene instalado de forma nativa.

¿Windows Defender es lo suficientemente eficaz por sí solo para mantener sus equipos protegidos? ¿Se debería adoptar alguna otra medida de seguridad?

Hay que tener en cuenta que en un computador la seguridad es descentralizada. No todo se trata del antivirus, gratuito o de pago. Por ejemplo, los principales navegadores de internet pueden detectar y bloquear sitios maliciosos. Lo mismo ocurre si estamos por descargar algún programa no reconocido.

En el caso de los proveedores de correos electrónicos, estos se encargan de analizar archivos adjuntos en busca de virus antes de que sean descargados. Además, no podemos negar lo eficaces que son contra los mensajes de spam. Todos estos factores se van sumando y, junto con el antivirus, crean un muro bastante sólido que impide que softwares o amenazas informáticas pasen con facilidad.

Hablan los expertos

Fabio Assolini, director del Equipo de Investigación y Análisis para América Latina en Kaspersky, considera que sí es necesario tener un antivirus, ya que el que viene preinstalado con Windows no es suficiente.

“Windows Defender es un antivirus muy básico, no tiene recursos avanzados de protección, por ejemplo, contra ataques más complejos de ransomware, que son códigos maliciosos que secuestran los archivos de nuestro computador y por los cuales piden un rescate. Además, es muy fácil que un código malicioso, al instalarse en un sistema, desactive el antivirus de Microsoft. Con otro producto que tiene más experiencia y más conocimiento de las amenazas eso sería mucho más difícil, quizá imposible”, señala Assolini.

Por su parte, Élmer Quiroz, especialista en ciberseguridad y docente de la Universidad Científica del Sur (Perú), concuerda con Assolini en cuanto a que lo más indicado sería tener una capa de seguridad extra.

“Cuando (el antivirus) viene por defecto en el sistema operativo o, inclusive, cuando se da a conocer un SO nuevo, siempre trae detrás de él vulnerabilidades, porque es la primera versión. Posteriormente se va a ir actualizando, pero se trata de una seguridad muy básica. Lo ideal es tener otro antivirus más completo para proteger nuestro computador”, señala el experto en ciberseguridad.

(También: El controversial correo de Elon Musk a sus empleados para ‘ponerse la diez’)

“Ahora, hay muchos tipos de antivirus y de todos los precios. Hay servicios que brindan solo antivirus, otros que vienen con antimalware o con antispyware. Sería ideal tener los tres, pero ya depende de las necesidades y economía de cada usuario”, agrega Quiroz.

En un artículo para Wirecutter, de The New York Times, los periodistas Kevin Purdy y Thorin Klosowski, tras un exhaustivo análisis de informes y pruebas en laboratorios informáticos, llegaron a la conclusión de que no se puede confiar la seguridad de nuestro computador a un solo antivirus, ya que han demostrado ser vulnerables en alguna ocasión. Ninguno de estos programas puede detectar absolutamente todos los softwares y ataques malintencionados que llegan al equipo.

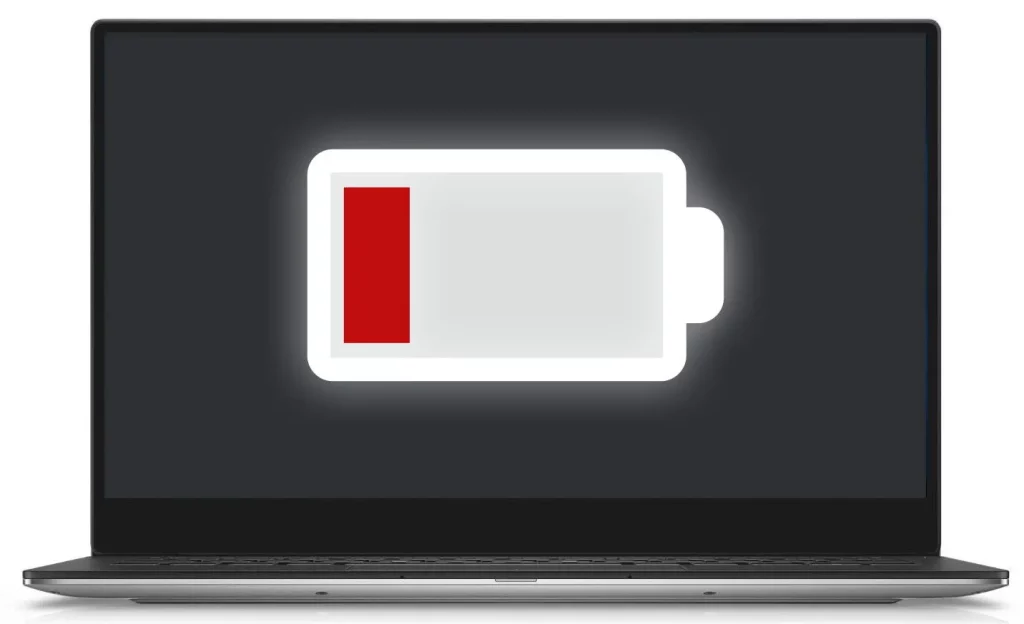

Por eso, el usuario debe tomar un rol activo en la protección de su información. “Se necesitan contraseñas seguras, inicios de sesión de dos factores, cifrado de datos, copias de seguridad de todo el sistema, actualizaciones automáticas de software y herramientas de privacidad inteligentes. Y también se debe tener en cuenta lo que se descarga y hacerlo únicamente de fuentes oficiales, como Microsoft App Store o App Store. Muy importante también es evitar descargar y abrir archivos adjuntos de correos electrónicos, a menos que se esté muy seguro de que son confiables”, señalan los periodistas en su artículo.

A su vez, Jared Newman escribe para el medio especializado PCWorld que “Windows Defender rivaliza con otros programas en la detección de virus. Aunque no siempre ha sido así, la detección de Microsoft ha mejorado considerablemente en los últimos años, hasta el punto de que AV-Test lo califica regularmente con un 6 de 6 en protección, facilidad de uso y rendimiento, superando la media del sector”.

Para Newman, el antivirus, al fin y al cabo, no es más que otra línea de defensa. Y para la mayoría de usuarios, las defensas integradas de Microsoft deberían ser lo suficientemente fuertes. En esto concuerdan también los periodistas de The New York Times. Y, al igual que lo hace Quiroz, consideran que si se quiere añadir una capa extra de seguridad, es válido descargar un antimalware, que podría detectar aspectos que Defender podría pasar por alto.

Depende de cada uno finalmente elegir el tipo de defensa que le conviene más. Probablemente para usuarios avanzados, o que manejan información confidencial o de riesgo, es importante que adquieran la mayor protección posible.

Fuente: eltiempo.com